Erfahren Sie, wie Sie KI-Modelle gezielt optimieren, Leistung steigern und Kosten senken – mit Strategien, Tools und besten Lösungen für maximale Effizienz.

KI-Modelle optimieren bedeutet, vorhandene Systeme gezielt so anzupassen, dass sie schneller, genauer und effizienter arbeiten. Ob Sprachmodell, Bildgenerator oder Analysesystem – mit den richtigen Methoden holen Sie deutlich mehr aus bestehenden Modellen heraus.

Dieser Artikel zeigt Ihnen deshalb konkret, welche Techniken 2026 wirklich funktionieren, welche Tools sich bewährt haben und wie Sie systematisch vorgehen.

Was bedeutet es, ein KI-Modell zu optimieren?

KI-Modelle optimieren umfasst alle Maßnahmen, die dazu beitragen, die Leistung eines Modells zu verbessern – ohne es zwingend komplett neu zu trainieren. Dabei geht es einerseits um die Ausgabequalität, also wie präzise, relevant und zuverlässig die Ergebnisse sind. Andererseits spielen jedoch auch Geschwindigkeit, Ressourceneffizienz und Kosten eine wichtige Rolle.

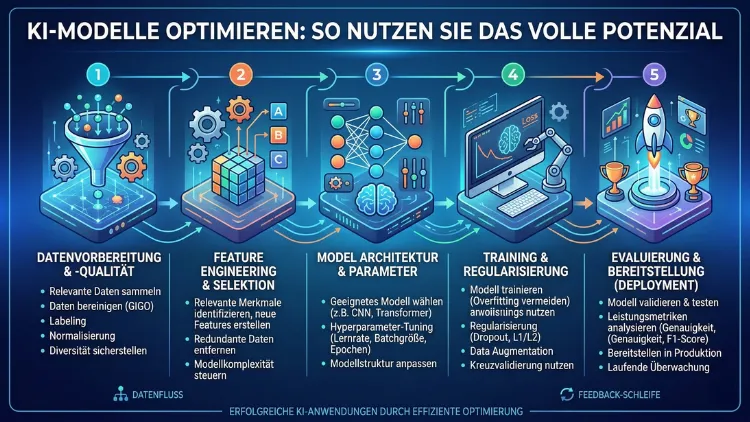

Grundsätzlich unterscheidet man drei Ebenen:

1. Modell-Ebene: Hier werden Hyperparameter, Architektur oder Gewichtungen direkt angepasst. Das erfordert technisches Know-how und Zugang zu Trainingsdaten.

2. Prompt-Ebene: Diese Methode ist zugänglicher und deshalb für viele Anwender besonders relevant. Durch gezieltes Prompt-Engineering lässt sich die Ausgabe eines Modells erheblich verbessern, ohne eine einzige Codezeile zu ändern.

3. Systemebene: Hierbei optimiert man die Umgebung, in der das Modell läuft – zum Beispiel durch Caching, Parallelisierung oder den Einsatz von Retrieval-Augmented Generation (RAG).

Zudem ist es wichtig zu verstehen, dass Optimierung kein einmaliger Prozess ist. Vielmehr handelt es sich um einen kontinuierlichen Kreislauf aus Testen, Messen und Verbessern.

Prompt-Engineering: Der schnellste Hebel zur Verbesserung

Prompt-Engineering ist die effektivste Methode, wenn Sie ein KI-Modell ohne technischen Aufwand verbessern möchten. Dabei formulieren Sie Eingaben so präzise, dass das Modell genau das liefert, was Sie brauchen.

Die wichtigsten Prompt-Techniken 2026

Chain-of-Thought-Prompting ist besonders wirksam bei komplexen Aufgaben. Statt direkt nach einem Ergebnis zu fragen, fordern Sie das Modell auf, seinen Denkweg Schritt für Schritt darzulegen. Zum Beispiel: „Lösen Sie diese Aufgabe und erklären Sie dabei jeden Schritt.“ Dadurch reduzieren sich Fehler nachweislich.

Few-Shot-Prompting funktioniert ähnlich gut. Sie geben dem Modell zwei bis fünf Beispiele des gewünschten Formats, bevor Sie Ihre eigentliche Frage stellen. Das Modell erkennt dadurch das Muster und liefert konsistentere Ergebnisse.

System-Prompts sind außerdem entscheidend, wenn Sie ein Modell dauerhaft in einem bestimmten Kontext einsetzen. Definieren Sie dort die Rolle, den Ton und die Einschränkungen des Modells präzise.

Empfehlung: Nutzen Sie PromptLayer (promptlayer.com), um Prompts systematisch zu versionieren, zu testen und zu vergleichen. Die Plattform speichert alle Prompt-Varianten, misst Antwortqualität und hilft Ihnen so, kontinuierlich zu verbessern.

Fine-Tuning: Wenn Standard nicht reicht

Fine-Tuning ist die nächste Stufe, wenn Prompt-Engineering an seine Grenzen stößt. Dabei trainieren Sie ein bestehendes Basismodell auf Ihren eigenen Datensatz nach, sodass es sich für Ihre spezifische Domäne spezialisiert.

Wann lohnt sich Fine-Tuning?

Fine-Tuning ist sinnvoll, wenn Sie über mindestens 50 bis 100 hochwertige Trainingsbeispiele verfügen und das Modell regelmäßig dieselben Aufgabentypen erledigen soll. Außerdem empfiehlt sich diese Methode, wenn das Modell einen sehr spezifischen Stil, Fachvokabular oder eine bestimmte Antwortstruktur erlernen soll.

Empfehlung für Fine-Tuning mit OpenAI-Modellen: Nutzen Sie die OpenAI Fine-Tuning API. Konkret gehen Sie so vor:

- Erstellen Sie eine JSONL-Datei mit Trainingspaaren im Format

{"messages": }. - Laden Sie die Datei über die API hoch:

openai.files.create(file=open("training.jsonl", "rb"), purpose="fine-tune"). - Starten Sie den Fine-Tuning-Job:

openai.fine_tuning.jobs.create(training_file="file-id", model="gpt-4o-mini"). - Überwachen Sie den Fortschritt mit

openai.fine_tuning.jobs.retrieve("job-id").

Für Open-Source-Modelle wie Llama 3 empfehlen wir dagegen Unsloth (github.com/unslothai/unsloth). Dieses Framework reduziert den Speicherbedarf beim Fine-Tuning um bis zu 70 % und beschleunigt den Prozess erheblich. Die Installation erfolgt über pip install unsloth, danach laden Sie ein vortrainiertes Modell und starten das Training mit wenigen Zeilen Python-Code.

Retrieval-Augmented Generation (RAG): Aktuelles Wissen integrieren

RAG ist eine der wichtigsten Optimierungsmethoden, wenn das Modell mit aktuellen oder unternehmensspezifischen Informationen arbeiten soll. Statt das Wissen direkt ins Modell zu trainieren, ruft das System zur Laufzeit relevante Dokumente aus einer Wissensbasis ab und übergibt sie zusammen mit der Nutzerfrage an das Modell.

Empfohlene Vorgehensweisen bei RAG

Zunächst ist die Qualität der Wissensbasis entscheidend. Schlecht strukturierte oder veraltete Dokumente führen unweigerlich zu schlechteren Antworten. Bereinigen und aktualisieren Sie Ihre Datenbasis deshalb regelmäßig.

Außerdem beeinflusst die Chunk-Größe (also die Größe der Textabschnitte, die indexiert werden) die Qualität erheblich. Erfahrungsgemäß liefern Chunks mit 256 bis 512 Tokens gute Ergebnisse. Zu kleine Chunks verlieren Kontext, zu große enthalten unnötige Informationen.

Empfehlung: Verwenden Sie LlamaIndex (llamaindex.ai) für den Aufbau Ihrer RAG-Pipeline. LlamaIndex unterstützt zahlreiche Datenquellen (PDFs, Datenbanken, Websites), bietet integriertes Chunking und ermöglicht es, verschiedene Retrieval-Strategien einfach zu vergleichen. Die Einrichtung erfolgt über pip install llama-index, danach laden Sie Ihre Dokumente, erstellen einen Index und stellen Anfragen direkt über die Python-API.

Hyperparameter-Optimierung: Das Maximum aus dem Training herausholen

Wer Modelle selbst trainiert oder nachtrainiert, stößt unweigerlich auf das Thema Hyperparameter. Diese Einstellungen – zum Beispiel Lernrate, Batch-Größe, Dropout-Rate oder Anzahl der Epochen – haben enormen Einfluss auf die Modellleistung. Jedoch ist es zeitaufwendig, sie manuell auszuprobieren.

Empfehlung: Nutzen Sie Optuna (optuna.org) für die automatische Hyperparameter-Suche. Optuna verwendet einen intelligenten Suchalgorithmus, der gezielt vielversprechende Parameterkombinationen testet, anstatt alle Möglichkeiten blind durchzuprobieren. So installieren Sie Optuna: pip install optuna. Anschließend definieren Sie eine Zielfunktion, in der Sie die zu optimierenden Parameter als Suchraum angeben, und lassen Optuna die besten Werte finden.

Zusätzlich empfehlen wir Weights & Biases (wandb.ai) für das Experiment-Tracking. Das Tool visualisiert Trainingsläufe, vergleicht Metriken und hilft Ihnen, nachzuvollziehen, welche Parameterkombination zu welchen Ergebnissen geführt hat.

Quantisierung und Modellkomprimierung: Effizienz steigern

Quantisierung ist eine Technik, die große Modelle deutlich kleiner und schneller macht – ohne die Ausgabequalität wesentlich zu verschlechtern. Dabei werden die Gewichte des Modells von 32-Bit-Gleitkommazahlen auf 8-Bit- oder sogar 4-Bit-Ganzzahlen reduziert. Dadurch sinkt einerseits der Speicherbedarf, andererseits steigt die Inferenzgeschwindigkeit erheblich.

Empfehlung: Für lokale Modelle empfehlen wir llama.cpp (github.com/ggerganov/llama.cpp) in Kombination mit dem GGUF-Format. Laden Sie ein bereits quantisiertes Modell von Hugging Face (huggingface.co) herunter – dort finden Sie viele Modelle in verschiedenen Quantisierungsstufen (Q4_K_M, Q8_0 etc.). Q4_K_M bietet dabei ein gutes Gleichgewicht zwischen Geschwindigkeit und Qualität und ist deshalb für die meisten Anwendungsfälle empfehlenswert.

Für den produktiven Einsatz in der Cloud ist außerdem vLLM (github.com/vllm-project/vllm) eine ausgezeichnete Wahl. Es ermöglicht schnelle Inferenz durch PagedAttention und unterstützt Batch-Verarbeitung, was die Kosten pro Anfrage stark senkt.

Evaluierung und Monitoring: Den Fortschritt messen

Optimierung ohne Messung ist sinnlos. Deshalb brauchen Sie klare Evaluierungsmetriken, bevor Sie irgendwelche Veränderungen vornehmen.

Quantitative Metriken

Für Sprachmodelle sind BLEU, ROUGE und BERTScore gängige Metriken. Für Klassifikationsaufgaben nutzen Sie Präzision, Recall und F1-Score. Für generative Aufgaben empfehlen sich außerdem menschliche Bewertungen oder LLM-as-a-Judge-Ansätze, bei denen ein anderes KI-Modell die Ausgabequalität bewertet.

Empfehlung: Setzen Sie LangSmith (smith.langchain.com) für das laufende Monitoring ein. Das Tool protokolliert jede Anfrage und Antwort, zeigt Latenz und Fehlerquoten an und ermöglicht es, Regressionstests zu definieren. So erkennen Sie sofort, wenn eine Änderung die Qualität verschlechtert hat.

Empfohlene Vorgehensweisen beim Aufbau einer Evaluierungspipeline

Erstellen Sie zunächst ein Goldstandard-Datensatz mit 50 bis 200 repräsentativen Beispielen, für die Sie die erwartete Ausgabe kennen. Testen Sie jede Änderung am Modell oder Prompt gegen diesen Datensatz. Dokumentieren Sie außerdem alle Ergebnisse, sodass Sie Fortschritte und Rückschritte nachvollziehen können.

Kontextfenster und Token-Management

Ein häufig unterschätzter Aspekt bei der Optimierung ist das Token-Management. Jedes moderne KI-Modell hat ein begrenztes Kontextfenster – also eine maximale Menge an Text, die es gleichzeitig verarbeiten kann. Unnötige Tokens in Prompts verschwenden jedoch nicht nur Platz, sondern erhöhen auch die Kosten und können die Aufmerksamkeit des Modells auf irrelevante Informationen lenken.

Deshalb empfehlen wir folgende Vorgehensweise: Kürzen Sie System-Prompts auf das Wesentliche. Entfernen Sie redundante Formulierungen. Nutzen Sie außerdem Prompt-Komprimierungsbibliotheken wie LLMLingua (github.com/microsoft/LLMLingua), die lange Eingaben automatisch zusammenfassen, ohne wesentliche Informationen zu verlieren.

Agentische KI und Tool-Use optimieren

Im Jahr 2026 sind KI-Agenten – also Systeme, die selbstständig Werkzeuge aufrufen und mehrstufige Aufgaben lösen – weit verbreitet. Jedoch scheitern viele agentische Systeme an schlechter Planung oder fehlerhafter Tool-Nutzung.

Empfehlung: Nutzen Sie LangGraph (github.com/langchain-ai/langgraph) für den Aufbau zuverlässiger Agenten. LangGraph modelliert den Agentenprozess als gerichteten Graphen, was Ihnen ermöglicht, Fehlerbehandlung, Schleifen und Fallback-Strategien präzise zu definieren. Zusätzlich empfehlen wir, Agenten mit strukturiertem Output (z. B. JSON-Schemata via Pydantic) zu verbinden, da dies die Zuverlässigkeit der Tool-Aufrufe erheblich verbessert.

Datenkualität: Die wichtigste Grundlage jeder Optimierung

Alle technischen Optimierungen helfen nichts, wenn die Trainingsdaten oder die Eingabedaten von schlechter Qualität sind. Deshalb gilt grundsätzlich: Garbage in, garbage out.

Achten Sie bei eigenen Trainingsdaten auf Diversität, Konsistenz und korrekte Beschriftung. Zudem sollten Sie Duplikate und widersprüchliche Beispiele entfernen, da diese das Modell verwirren. Für die Datenkuration empfehlen wir Argilla (argilla.io), ein Open-Source-Tool für die kollaborative Annotation und Qualitätssicherung von KI-Trainingsdaten.

FAQ: Häufige Fragen zur KI-Modell-Optimierung

Wie lange dauert das Fine-Tuning eines KI-Modells?

Das hängt stark von der Modellgröße und Datenmenge ab. Für kleine Modelle wie GPT-4o-mini dauert ein Fine-Tuning-Job mit 500 Beispielen üblicherweise 15 bis 60 Minuten. Für größere Open-Source-Modelle mit Unsloth auf einer A100-GPU kann es jedoch mehrere Stunden dauern.

Muss ich ein KI-Modell neu trainieren, um es zu verbessern?

Nein. In den meisten Fällen reicht Prompt-Engineering oder RAG aus, um die Qualität erheblich zu steigern. Fine-Tuning und Neutraining sind erst dann sinnvoll, wenn Sie sehr spezifische Anforderungen haben, die sich nicht durch Prompts lösen lassen.

Welche Modelle eignen sich am besten für das Fine-Tuning?

2026 empfehlen wir Llama 3.3 (70B oder 8B) für Open-Source-Projekte sowie GPT-4o-mini für kommerzielle Anwendungen. Beide Modelle sind gut dokumentiert, bieten fine-tuning-freundliche Lizenzen und liefern nach dem Training exzellente Ergebnisse.

Was kostet die Optimierung eines KI-Modells?

Die Kosten variieren stark. Prompt-Optimierung ist kostenlos. Fine-Tuning mit der OpenAI-API kostet je nach Datenmenge zwischen wenigen Euro und mehreren Hundert Euro. Das Training eigener Modelle auf Cloud-GPUs kann dagegen schnell mehrere Tausend Euro kosten.

Wie viele Trainingsdaten brauche ich für ein gutes Fine-Tuning?

Als Faustregel gilt: 50 bis 100 hochwertige Beispiele sind ein Minimum. Mit 500 bis 1.000 Beispielen erzielen Sie in der Regel deutlich stabilere Ergebnisse. Qualität ist dabei wichtiger als Quantität – 100 perfekt kuratierte Beispiele schlagen 1.000 fehlerhafte.

Kann ich ein KI-Modell ohne Programmierkenntnisse optimieren?

Ja, zumindest auf der Prompt-Ebene. Tools wie PromptLayer oder der Playground von OpenAI ermöglichen es, Prompts zu testen und zu vergleichen, ohne Code schreiben zu müssen. Fine-Tuning und RAG erfordern jedoch grundlegende Python-Kenntnisse.

Was ist der Unterschied zwischen Fine-Tuning und RAG?

Fine-Tuning verändert die Gewichtungen des Modells dauerhaft – es lernt neues Verhalten. RAG hingegen gibt dem Modell zur Laufzeit relevante Dokumente mit, ohne es zu verändern. RAG ist einfacher umzusetzen und flexibler, Fine-Tuning ist jedoch besser, wenn das Modell einen bestimmten Stil oder spezifisches Fachvokabular lernen soll.

Wie erkenne ich, ob mein optimiertes Modell wirklich besser ist?

Nur durch systematische Evaluierung mit einem definierten Testdatensatz. Ohne Baseline-Messung vor der Optimierung können Sie keine fundierte Aussage treffen. Deshalb ist es wichtig, vor jeder Änderung Metriken zu erheben.

Warum verschlechtert sich mein Modell nach dem Fine-Tuning?

Das häufigste Problem ist Catastrophic Forgetting – das Modell verliert allgemeines Wissen, wenn es zu stark auf einen engen Datensatz trainiert wird. Außerdem können widersprüchliche oder fehlerhafte Trainingsdaten die Qualität senken. Nutzen Sie deshalb LoRA (Low-Rank Adaptation) statt Full Fine-Tuning, da diese Methode das ursprüngliche Wissen besser bewahrt.

Welche Rolle spielt die Inferenzgeschwindigkeit bei der Optimierung?

Eine sehr wichtige. Langsame Modelle sind in der Praxis schwer nutzbar. Quantisierung, Batch-Verarbeitung und Caching (zum Beispiel für häufig gestellte Fragen) reduzieren die Latenz erheblich. Zudem senken sie die Kosten pro Anfrage, was besonders bei skalierten Anwendungen entscheidend ist.

Fazit

KI-Modelle optimieren ist kein einmaliges Projekt, sondern ein kontinuierlicher Prozess. Starten Sie mit Prompt-Engineering und RAG – diese Methoden liefern schnelle Ergebnisse ohne großen Aufwand. Bauen Sie anschließend eine solide Evaluierungspipeline auf und führen Sie Fine-Tuning oder Quantisierung gezielt ein, wenn Sie konkrete Grenzen erreichen.

Wer systematisch vorgeht, misst und iteriert, holt das volle Potenzial aus modernen KI-Modellen heraus. Die vorgestellten Tools – PromptLayer, Unsloth, LlamaIndex, Optuna und LangSmith – bieten deshalb einen praxiserprobten Einstieg für jede Optimierungsstufe.