Erfahren Sie, wie Sie KI-Agenten bauen und autonome Workflows erstellen, die Prozesse automatisieren, Zeit sparen und Produktivität steigern.

Autonome KI-Agenten erledigen komplexe Aufgaben selbstständig – ohne manuellen Eingriff. Deshalb setzen immer mehr Unternehmen auf diese Technologie, um Prozesse zu beschleunigen und Mitarbeiter zu entlasten.

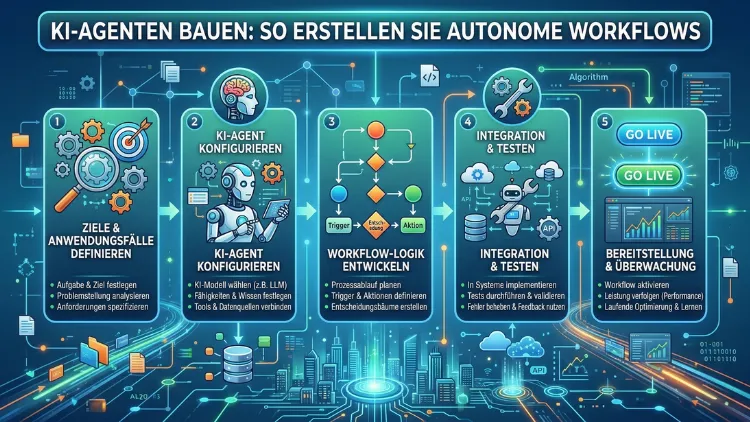

In diesem Artikel erfahren Sie, wie Sie einen KI-Agenten Schritt für Schritt aufbauen, welche Frameworks sich eignen und wie Sie autonome Workflows sicher in Ihren Alltag integrieren.

Was ist ein KI-Agent und warum lohnt sich der Aufbau?

KI-Agenten sind autonome Software-Assistenten, die komplexe Aufgaben eigenständig ausführen. Der entscheidende Unterschied zu einem klassischen Chatbot liegt in der Handlungsfähigkeit: Während ein Chatbot auf eine Anfrage reagiert und dann wartet, plant ein KI-Agent mehrere Schritte voraus, trifft selbstständig Entscheidungen und greift dabei auf verschiedene externe Werkzeuge zu. Zudem lernt er aus den Ergebnissen seiner Aktionen.

2026 ist das Jahr der Agenten, weil wir endlich verstehen, was sie sind: keine magischen Problemlöser, sondern gut orchestrierte Softwarekomponenten. Außerdem zeigen aktuelle Prognosen, wie groß das Marktpotenzial ist: Bis 2027 werden 33 % der Unternehmenssoftwareanwendungen mit agentenbasierter KI arbeiten und bis zu 15 % der täglichen Arbeitsentscheidungen autonom treffen.

Ein KI-Agent besteht grundsätzlich aus vier Kernkomponenten:

- Wahrnehmung: Der Agent empfängt Eingaben aus seiner Umgebung, zum Beispiel Texte, Daten oder Ereignisse.

- Reasoning: Ein Large Language Model (LLM) interpretiert diese Eingaben und plant die nächsten Schritte.

- Aktionsausführung: Der Agent nutzt definierte Werkzeuge, etwa APIs, Suchmaschinen oder Datenbanken.

- Gedächtnis: Kurzzeit- und Langzeitgedächtnis ermöglichen es, den Kontext über mehrere Schritte hinweg zu erhalten.

Deshalb eignen sich KI-Agenten besonders gut für Aufgaben, die bisher zu komplex für einfache Automatisierungen waren – zum Beispiel mehrstufige Recherchen, automatisierte Berichterstellung oder dynamisches Prozessmanagement.

Wie autonome Workflows funktionieren

Im Kern ist ein KI-Agenten-Workflow ein automatisierter Prozess, der von einem KI-„Agenten“ gesteuert wird. Dieser kann Informationen wahrnehmen, Entscheidungen treffen und Maßnahmen ergreifen, um ein definiertes Ziel zu erreichen.

KI-Agenten-Workflows funktionieren wie ein Team von KI-Agenten, die in Echtzeit kommunizieren, argumentieren und ihre Aktionen anpassen. Jeder Agent hat spezialisierte Rollen, wie zum Beispiel Datenerfassung, Analyse, Entscheidungsfindung oder Ausführung, und sie arbeiten zusammen, um Workflows dynamisch zu optimieren.

Herkömmliche Automatisierungen folgen dem Prinzip „Wenn X, dann Y“ – und scheitern daher, sobald unerwartete Situationen auftreten. Autonome KI-Workflows hingegen sind adaptiv: Sie erkennen Ausnahmen, passen ihre Strategie an und fragen bei echten Unsicherheiten gezielt nach menschlicher Rückmeldung. Zudem können mehrere Agenten parallel arbeiten und sich gegenseitig Ergebnisse übergeben – das nennt man Multi-Agent-Architektur.

Voraussetzungen: Was Sie vor dem Start wissen müssen

Bevor Sie mit dem Aufbau eines KI-Agenten beginnen, sollten Sie drei Grundlagen klären:

1. Ziel und Anwendungsfall definieren

Starten Sie mit einem klar abgegrenzten Problem. Fragen Sie sich: Welche Aufgabe soll der Agent übernehmen? Wie hoch ist die Fehlertoleranz? Welche Datenquellen sind erforderlich? Ein gut definierter Anwendungsfall spart später erheblich Zeit beim Testen und Optimieren.

2. Technischen Stack wählen

Für die meisten Projekte benötigen Sie einen LLM-Anbieter (zum Beispiel OpenAI GPT-4o oder Anthropic Claude), ein Agent-Framework sowie optionale Integrationen für externe Dienste. Zudem ist ein Vektorspeicher für das Gedächtnis des Agenten sinnvoll, wenn er auf große Wissensdatenbanken zugreifen soll.

3. Datenschutz und Governance bedenken

Entscheidend ist, dass KI mit den Werten des Unternehmens im Einklang steht – und keine neuen Risiken wie Diskriminierung oder Datenschutzprobleme mit sich bringt. Klären Sie daher von Anfang an, welche Daten der Agent verarbeitet und ob eine DSGVO-konforme Lösung erforderlich ist.

Die richtigen Frameworks und Plattformen wählen

Die Wahl des richtigen Werkzeugs ist entscheidend. Deshalb stellen wir Ihnen die wichtigsten Optionen im Überblick vor:

LangChain – empfohlen für Entwickler

LangChain bietet Tools zum Erstellen, Orchestrieren und Bereitstellen autonomer KI-Agenten, die komplexe, mehrstufige Workflows bewältigen können. Außerdem können Sie mit LangChain klein anfangen: Speicher, Suche und Aktionen lassen sich schrittweise hinzufügen. Die visuelle LangGraph Studio IDE beschleunigt dabei die Entwicklung erheblich.

Anleitung für den Einstieg mit LangChain:

- Installieren Sie LangChain über pip:

pip install langchain langchain-openai - Konfigurieren Sie Ihren OpenAI-API-Schlüssel als Umgebungsvariable.

- Definieren Sie die Werkzeuge Ihres Agenten (z. B. Web-Suche, Datenbankabfrage).

- Erstellen Sie einen

AgentExecutormit Ihrem LLM und den Werkzeugen. - Testen Sie den Agenten zunächst mit einfachen Aufgaben, bevor Sie komplexe Workflows hinzufügen.

n8n – empfohlen für No-Code/Low-Code-Einstieg

n8n ist eine Open-Source-Automatisierungsplattform, die sich hervorragend eignet, um KI-Agenten ohne tiefe Programmierkenntnisse zu bauen. Zudem lässt sich n8n selbst hosten, was besonders für datenschutzsensible Prozesse wichtig ist.

Anleitung für einen KI-Agenten in n8n:

- Starten Sie n8n lokal via Docker:

docker run -it --rm --name n8n -p 5678:5678 n8nio/n8n - Öffnen Sie die Oberfläche unter

http://localhost:5678. - Erstellen Sie einen neuen Workflow und fügen Sie den AI Agent-Knoten hinzu.

- Verbinden Sie ihn mit einem OpenAI-Knoten als LLM.

- Fügen Sie Werkzeugknoten hinzu, zum Beispiel HTTP Request, Google Sheets oder eine SQL-Datenbank.

- Speichern und aktivieren Sie den Workflow.

Microsoft Copilot Studio – empfohlen für Microsoft-Umgebungen

Microsoft Copilot Studio ermöglicht die Low-Code-Entwicklung von KI-Agenten per Drag-and-Drop. Ergänzt um Power Automate für Workflows und Power Platform Dataverse für Daten, können auch Nicht-Entwickler professionelle Agenten erstellen. Außerdem profitieren Microsoft-365-Nutzer von der nahtlosen Integration in Teams, Outlook und SharePoint.

CrewAI – empfohlen für Multi-Agent-Systeme

CrewAI ist ein Python-Framework, das speziell für die Zusammenarbeit mehrerer Agenten entwickelt wurde. Jeder Agent erhält eine Rolle, ein Ziel und ein Set von Werkzeugen – ähnlich wie Mitglieder eines echten Teams. Deshalb eignet sich CrewAI hervorragend für komplexe Projekte, bei denen verschiedene Aufgaben parallel bearbeitet werden sollen.

Schritt für Schritt: Ihren ersten KI-Agenten bauen

Hier folgt eine praxisnahe Anleitung, die Sie mit n8n und OpenAI GPT-4o umsetzen können. Deshalb ist dieses Beispiel auch für Einsteiger geeignet.

Schritt 1 – Anwendungsfall festlegen

Definieren Sie zunächst konkret, was Ihr Agent tun soll. Ein guter Einstieg ist zum Beispiel ein Recherche-Agent: Er empfängt eine Frage per E-Mail, sucht automatisch im Web und antwortet mit einer strukturierten Zusammenfassung.

Schritt 2 – Trigger einrichten

Erstellen Sie in n8n einen E-Mail-Trigger (IMAP) oder einen Webhook, der den Workflow startet, sobald eine neue Anfrage eintrifft. Zudem können Sie einen zeitgesteuerten Trigger nutzen, falls der Agent regelmäßige Aufgaben übernehmen soll.

Schritt 3 – KI-Agenten-Knoten konfigurieren

Fügen Sie den AI Agent-Knoten hinzu und wählen Sie GPT-4o als Modell. Formulieren Sie anschließend einen System-Prompt, der dem Agenten seine Rolle, seinen Auftrag und seine Einschränkungen erklärt. Ein guter System-Prompt ist präzise, klar und beschreibt auch, wie der Agent mit Ausnahmen umgehen soll.

Schritt 4 – Werkzeuge anbinden

Geben Sie dem Agenten Zugriff auf relevante Werkzeuge. Für einen Recherche-Agenten empfiehlt sich:

- SerpAPI oder Tavily für Websuchen

- Wikipedia-API für Hintergrundwissen

- Ein HTTP-Request-Knoten für individuelle APIs

Schritt 5 – Gedächtnis aktivieren

Aktivieren Sie für mehrstufige Gespräche das Fenster-Gedächtnis in n8n. Dadurch behält der Agent den Gesprächskontext über mehrere Runden. Zudem können Sie einen Vektorspeicher wie Pinecone oder Qdrant integrieren, wenn der Agent auf umfangreiche interne Dokumente zugreifen soll.

Schritt 6 – Ausgabe strukturieren und weiterleiten

Konfigurieren Sie den letzten Knoten so, dass die Antwort des Agenten automatisch per E-Mail, Slack oder in ein Dokument geschrieben wird. Dadurch entsteht ein vollständiger, geschlossener Workflow.

Schritt 7 – Testen und iterieren

Testen Sie Ihren Agenten zunächst mit einfachen, kontrollierten Eingaben. Prüfen Sie dabei, ob der Agent die erwarteten Werkzeuge nutzt und korrekte Schlussfolgerungen zieht. Außerdem sollten Sie Fehlerfälle gezielt simulieren, zum Beispiel fehlende Daten oder mehrdeutige Anfragen.

Multi-Agent-Systeme: Wenn ein Agent nicht reicht

Unter dem intelligenten, autonomen Verhalten eines Agenten liegt meist eine Kombination aus strukturierter JSON-Ausgabe, deterministischem Code und gezielter Steuerung. Für besonders komplexe Aufgaben empfiehlt sich deshalb eine Multi-Agent-Architektur.

Dabei übernimmt ein Orchestrator-Agent die Koordination: Er empfängt die übergeordnete Aufgabe, zerlegt sie in Teilaufgaben und delegiert diese an spezialisierte Subagenten. Jeder Subagent bearbeitet seinen Teil selbstständig und gibt das Ergebnis an den Orchestrator zurück. Dieser fasst die Teilergebnisse zusammen und liefert die finale Antwort.

CrewAI Schritt-für-Schritt (Python):

- Installieren Sie CrewAI:

pip install crewai crewai-tools - Definieren Sie Ihre Agenten mit Rolle, Ziel und Hintergrundgeschichte.

- Erstellen Sie Tasks, die jedem Agenten zugewiesen werden.

- Bilden Sie eine Crew aus Agenten und Tasks.

- Starten Sie die Ausführung mit

crew.kickoff.

Zudem bietet CrewAI die Möglichkeit, den Prozesstyp zu wählen: sequenziell (ein Agent nach dem anderen) oder hierarchisch (Orchestrator delegiert an Subagenten).

Empfohlene Vorgehensweisen beim Aufbau autonomer Workflows

Erfahrene KI-Entwickler haben in der Praxis eine Reihe von Grundsätzen entwickelt, die den Unterschied zwischen einem stabilen und einem fragilen System ausmachen:

Kleine Schritte statt großer Sprünge: Beginnen Sie klein mit einem hochwertigen Workflow in den Bereichen Support, Betrieb oder Marketing und erweitern Sie dann, sobald die Ergebnisse klar sind.

„Human in the Loop“ einplanen: Besonders bei kritischen Entscheidungen sollte ein Mensch die Möglichkeit haben, den Agenten zu stoppen oder zu korrigieren. Zudem reduziert diese Kontrollebene das Risiko von Folgefehlern erheblich.

Logging und Monitoring: Alle Aktionen des Agenten sollten protokolliert werden. Deshalb empfiehlt sich der Einsatz von Tools wie LangSmith (für LangChain-basierte Agenten) oder das integrierte Logging von n8n.

Prompt-Versionierung: Behandeln Sie System-Prompts wie Quellcode. Speichern Sie Versionen, kommentieren Sie Änderungen und testen Sie neue Prompt-Versionen vor dem Einsatz in der Produktion.

Werkzeuge beschränken: Geben Sie dem Agenten nur Zugriff auf die Werkzeuge, die er tatsächlich benötigt. Dadurch reduzieren Sie unerwünschte Aktionen und verbessern gleichzeitig die Nachvollziehbarkeit.

Typische Anwendungsfälle in Unternehmen

Autonome KI-Agenten lassen sich in nahezu jedem Unternehmensbereich einsetzen. Besonders bewährt haben sich dabei folgende Szenarien:

- Kundenservice-Agent: Beantwortet häufige Anfragen automatisch, eskaliert komplexe Fälle an menschliche Mitarbeiter und dokumentiert alle Interaktionen im CRM.

- Datenanalyse-Agent: Lädt regelmäßig Berichte aus verschiedenen Quellen, analysiert Trends und erstellt automatisch strukturierte Zusammenfassungen für das Management.

- Content-Recherche-Agent: Sammelt täglich relevante Nachrichten aus definierten Quellen, bewertet die Relevanz und stellt eine priorisierte Leseliste zusammen.

- Onboarding-Agent: Führt neue Mitarbeiter durch Checklisten, beantwortet Fragen zu internen Prozessen und stellt automatisch die nötigen Zugänge an.

- Code-Review-Agent: Analysiert Pull-Requests auf Schwachstellen, schlägt Verbesserungen vor und überprüft die Einhaltung von Coding-Richtlinien.

Der entscheidende Unterschied liegt in ihrer Handlungsfähigkeit: Während ein Standard-Chatbot auf Anfragen reagiert, kann ein KI-Agent proaktiv Aufgaben übernehmen, mehrere Schritte vorausplanen und dabei verschiedene externe Ressourcen nutzen.

Sicherheit und Datenschutz bei KI-Agenten

Autonome Systeme, die selbstständig handeln, erfordern besondere Sorgfalt in Bezug auf Sicherheit. Deshalb sollten Sie folgende Aspekte von Anfang an mitdenken:

Berechtigungen minimal halten: Richten Sie API-Zugänge mit minimalen Rechten ein. Ein Agenten, der nur lesen darf, kann keinen ungewollten Schreibzugriff verursachen.

DSGVO-Konformität prüfen: Sobald der Agent personenbezogene Daten verarbeitet, greifen die Regeln der Datenschutz-Grundverordnung. Deshalb empfiehlt sich für deutsche Unternehmen die Nutzung europäischer Anbieter oder Self-Hosted-Lösungen wie n8n.

Prompt-Injection-Angriffe abwehren: Externe Inhalte, die der Agent verarbeitet, könnten manipulierte Anweisungen enthalten. Validieren Sie deshalb alle externen Eingaben und beschränken Sie die Freiheitsgrade des Agenten in kritischen Bereichen.

KI-Agenten in der Microsoft-Umgebung unterliegen Enterprise-Grade-Security: Azure AD für Authentifizierung, rollenbasierte Zugriffskontrolle (RBAC), vollständige Audit-Logs und Verschlüsselung. Ähnliche Standards sollten Sie auch bei eigenen Implementierungen anstreben.

Kosten und Skalierung realistisch planen

Die Betriebskosten eines KI-Agenten setzen sich hauptsächlich aus den LLM-API-Kosten zusammen. Deshalb lohnt es sich, von Anfang an auf Effizienz zu achten:

- Caching nutzen: Wiederkehrende Anfragen sollten nicht jedes Mal erneut an das LLM gesendet werden.

- Modellgröße anpassen: Nicht jede Aufgabe erfordert GPT-4o. Für einfache Klassifikationen reicht oft ein günstigeres Modell wie GPT-4o-mini.

- Token-Verbrauch messen: Überwachen Sie regelmäßig den Token-Verbrauch, um unerwartete Kosten zu vermeiden.

Zudem empfiehlt sich ein gestaffelter Rollout: Starten Sie mit einem Pilotprojekt in einer Abteilung, messen Sie den Nutzen und skalieren Sie dann gezielt auf weitere Bereiche.

FAQ – Häufige Fragen zu KI-Agenten und autonomen Workflows

Was ist der Unterschied zwischen einem KI-Agenten und einem Chatbot?

Ein Chatbot beantwortet Fragen und wartet auf die nächste Eingabe. Ein KI-Agent hingegen handelt proaktiv: Er plant mehrere Schritte, nutzt Werkzeuge wie APIs oder Datenbanken und führt Aufgaben eigenständig durch – ohne dass jeder Schritt vom Menschen bestätigt werden muss. Deshalb eignen sich KI-Agenten für komplexe, mehrstufige Prozesse, während Chatbots für einfache Frage-Antwort-Interaktionen ausreichen.

Welches Framework empfiehlt sich für Einsteiger ohne Programmierkenntnisse?

Ohne Programmierkenntnisse empfehlen wir n8n oder Microsoft Copilot Studio. Beide Plattformen bieten visuelle Drag-and-Drop-Oberflächen und ermöglichen es, funktionsfähige KI-Agenten zu bauen, ohne eine einzige Zeile Code zu schreiben. Zudem bieten beide Tools eine umfangreiche Dokumentation und eine aktive Community.

Wie teuer ist der Betrieb eines KI-Agenten?

Die Kosten hängen stark vom Volumen und der Komplexität der Aufgaben ab. Einfache Agenten, die GPT-4o-mini nutzen, können für wenige Euro pro Monat betrieben werden. Komplexe Multi-Agent-Systeme mit intensivem LLM-Einsatz können hingegen mehrere Hundert Euro monatlich kosten. Deshalb ist eine genaue Kalkulation des Token-Verbrauchs vor dem Start empfehlenswert.

Wie sicher sind autonome KI-Agenten für den Unternehmenseinsatz?

Autonome Agenten sind so sicher, wie ihre Implementierung es ermöglicht. Deshalb sind klare Berechtigungskonzepte, vollständiges Logging, eine „Human in the Loop“-Funktion für kritische Aktionen sowie regelmäßige Überprüfungen der Agentenaktivitäten unerlässlich. Außerdem sollten Unternehmen Prompt-Injection-Risiken kennen und gezielt mitigieren.

Kann ein KI-Agent auf interne Unternehmensdaten zugreifen?

Ja, über sogenannte Retrieval-Augmented Generation (RAG) kann ein KI-Agent auf interne Dokumente, Wikis oder Datenbanken zugreifen. Dabei werden die Dokumente in einem Vektorspeicher wie Pinecone, Qdrant oder Weaviate gespeichert. Der Agent sucht bei jeder Anfrage nach den relevantesten Textstellen und nutzt diese als Kontext für seine Antwort.

Was sind Multi-Agent-Systeme und wann brauche ich sie?

Multi-Agent-Systeme bestehen aus mehreren spezialisierten Agenten, die zusammenarbeiten. Sie werden dann empfohlen, wenn eine einzelne Aufgabe zu komplex für einen Agenten ist oder verschiedene Teilaufgaben gleichzeitig bearbeitet werden sollen. Deshalb eignen sich Multi-Agent-Architekturen besonders für komplexe Analysen, umfangreiche Content-Produktion oder mehrstufige Softwareentwicklungsaufgaben.

Wie lange dauert es, einen ersten KI-Agenten zu bauen?

Mit n8n und einem klaren Anwendungsfall können Sie einen ersten funktionsfähigen Prototypen innerhalb eines Tages erstellen. Ein produktionsreifer, robuster Agent mit vollständigem Testing, Fehlerbehandlung und Monitoring erfordert jedoch in der Regel einige Wochen. Deshalb empfiehlt sich ein iterativer Ansatz: erst einfach starten, dann schrittweise erweitern.

Wie lerne ich am schnellsten, KI-Agenten zu bauen?

Empfohlen wird eine Kombination aus Theorie und Praxis. Konkret: Absolvieren Sie zunächst den kostenlosen Kurs „LangChain for LLM Application Development“ auf DeepLearning.ai. Bauen Sie anschließend sofort ein eigenes Kleinprojekt. Zudem bietet die offizielle n8n-Dokumentation unter docs.n8n.io praxisnahe Tutorials speziell für KI-Agenten.

Welche Branchen profitieren besonders von autonomen Workflows?

Besonders stark profitieren Kundenservice, Marketing, IT, Finanzwesen und Personalwesen. In diesen Bereichen gibt es viele repetitive, regelbasierte Aufgaben, die ein KI-Agent schneller und fehlerfreier erledigt als ein Mensch. Zudem sind in diesen Branchen die Datenmengen groß genug, um die Stärken eines lernfähigen, autonomen Systems voll auszuschöpfen.

Kann ich einen KI-Agenten ohne Cloud-Dienste selbst hosten?

Ja, das ist möglich. Mit n8n Self-Hosted (via Docker), Ollama als lokales LLM-Backend und Qdrant als lokalem Vektorspeicher lässt sich ein vollständig on-premises betriebener KI-Agent aufbauen. Zudem bietet diese Kombination maximale Datensicherheit, da keine Daten an externe Server übertragen werden.

Fazit

KI-Agenten bauen ist heute keine Raketenwissenschaft mehr. Mit Tools wie n8n, LangChain oder CrewAI setzen Sie autonome Workflows schnell und sicher um – auch ohne tiefes Programmierwissen. Deshalb lohnt es sich, jetzt zu starten: mit einem klaren Anwendungsfall, dem richtigen Framework und einem strukturierten Vorgehen.

Der Schlüssel zum Erfolg liegt nicht im komplexesten Agenten, sondern im nützlichsten. Starten Sie klein, messen Sie den Nutzen und erweitern Sie Ihre Agenten schrittweise. Außerdem zahlt sich eine solide Governance von Anfang an aus – für Vertrauen, Skalierbarkeit und langfristigen Mehrwert.